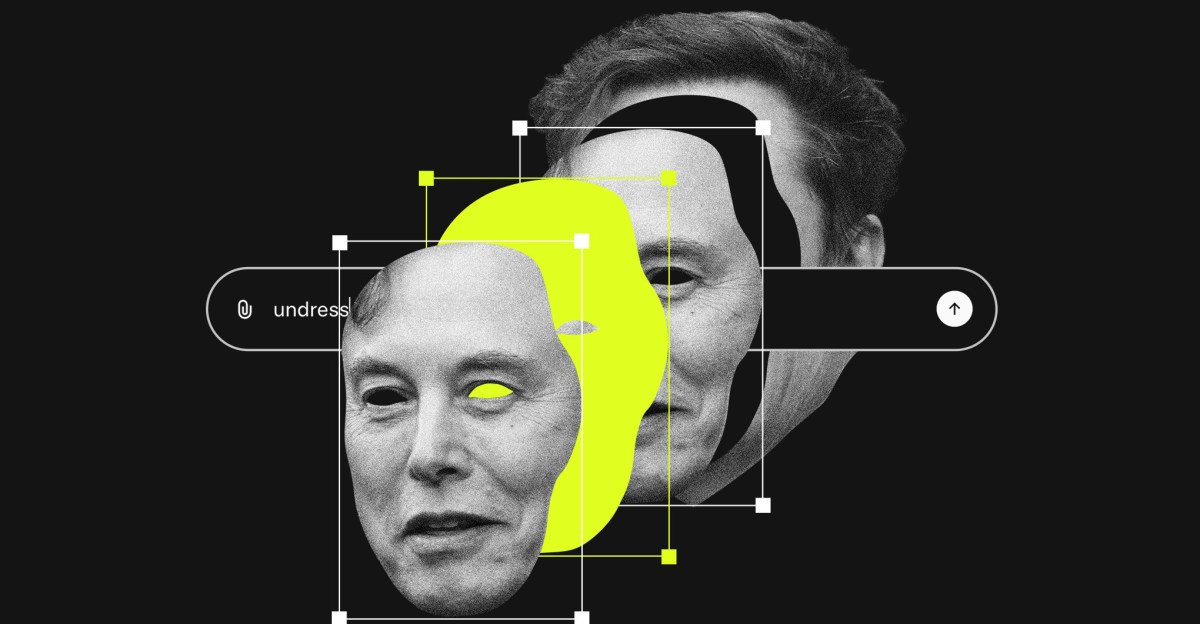

У світі штучного інтелекту розгортається одна з найсуперечливіших ситуацій, пов’язана з новим чат-ботом Grok, розробленим компанією xAI, заснованою Ілоном Маском. Цей продукт здобув погану репутацію через свою здатність створювати штучні зображення, зокрема й непристойні, без згоди їхніх учасників, включаючи жінок і неповнолітніх.

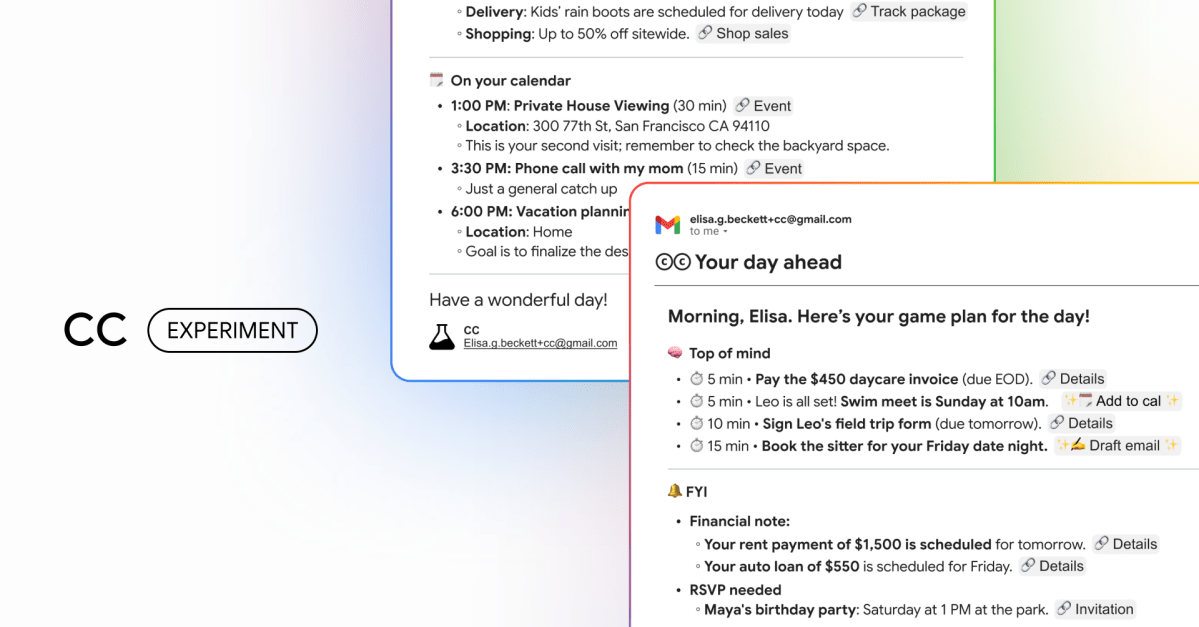

Grok інтегрований у платформу X (раніше відому як Twitter), що дозволяє користувачам легко редагувати будь-які зображення та поширювати їх серед інших користувачів. Незважаючи на численні запевнення з боку Маска, що в систему впроваджені запобіжники, їх виявилося легко обійти. Ситуація стала ще більш напруженою через юридичні загрози з боку урядів усього світу, які вимагають вжити заходів для захисту прав осіб, чий контент використовується без згоди.

Це викликало обговорення необхідності контролю за технологіями, здатними генерувати контент, що ображає й порушує права людини. Досліджуючи цю проблему, експерти зауважують, що питання регулювання контенту в Інтернеті є складним і потребує належної юридичної бази.

У програмі Decoder до обговорення залучено Ріану Пфефферкорн, експертку в політиці штучного інтелекту з Стенфордського інституту. Вона вказує на важливість розуміння правових рамок, які можуть вплинути на ситуацію. Багато в чому проблема полягає у відсутності чітких нормативних актів щодо модерації контенту в Інтернеті, які здатні б ефективно впливати на такі серйозні теми, як Grok.

Протягом останніх 20 років концепція модерації контенту на соціальних платформах зазнала суттєвих змін. Наразі спостерігається хаотичність у цій сфері, де платформи більше не дотримуються жорстких правил. У минулому, особливо під час пандемії COVID-19, контроль за дезінформацією та іншими негативними проявами набув високого значення. Проте здається, що ця ера минула, і нові виклики, зокрема від Grok, змушують суспільство переосмислити можливості повернення до більш контрольованого середовища.

Висновок полягає в тому, що незважаючи на технологічний прогрес, суспільство стикається з реальними викликами, пов’язаними з етикою і правами людини в контексті використання штучного інтелекту. Як реагуватимуть держави і технологічні компанії на цю ситуацію, покаже найближче майбутнє.